Tính năng mới của Apple sẽ ra mắt cuối năm nay, song đang vấp phải sự phản đối từ các chuyên gia bảo mật và quyền riêng tư.

Theo Neowin, là một phần của nỗ lực, Apple sẽ quét nội dung của ứng dụng Messages và iCloud của người dùng bằng cách sử dụng “máy học trên thiết bị”. Apple tuyên bố các công cụ nhằm phát hiện tài liệu lạm dụng tình dục trẻ em, từ đó không cho trẻ tiếp cận với tin nhắn và hình ảnh đó.

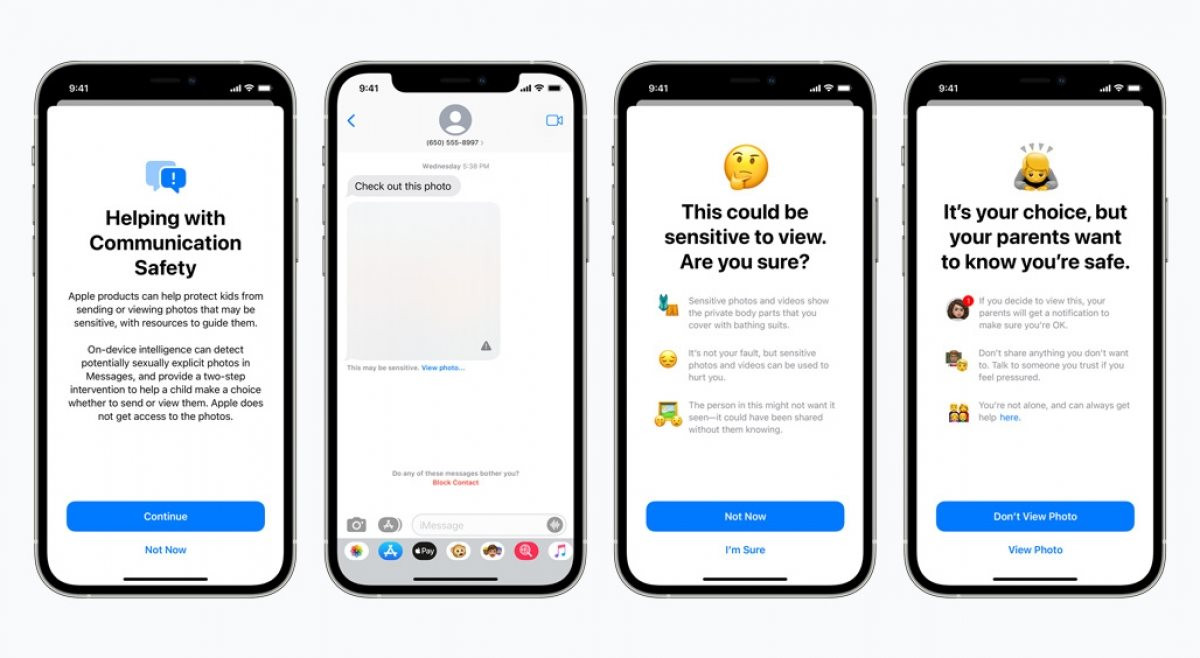

Apple cho biết tính năng mới này sẽ được triển khai vào cuối năm nay cho iPhone, iPad và Mac. “Táo khuyết” cho biết đây là một trong vài tính năng mới nhằm bảo vệ trẻ em tốt hơn trước các nguy cơ trực tuyến, bao gồm bộ lọc chặn hình ảnh khiêu dâm gửi và nhận qua tài khoản iMessage của trẻ. Một tính năng khác sẽ can thiệp khi người dùng cố tìm kiếm các từ khóa liên quan tới CSAM trên Siri và Search.

Tính năng an toàn mới cũng sẽ quét các hình ảnh liên quan đến lạm dụng trẻ em trong iCloud Photos của người dùng. Theo công ty, những bức ảnh như vậy được đối sánh bằng “công nghệ mật mã được gọi là giao điểm đặt riêng tư, xác định xem có trùng khớp hay không”. Quá trình này sử dụng dữ liệu của Trung tâm Quốc gia về Trẻ em Mất tích và Bị bóc lột (NCMEC). Apple nói rằng hệ thống sẽ không thể xem nội dung của iCloud Photos trừ khi nó phát hiện các hình ảnh lạm dụng trẻ em. Nó được cho là cung cấp mức độ chính xác cao với khả năng gắn cờ sai với tỷ lệ chưa đến 1/1 tỉ.

NeuralHash sử dụng kỹ thuật mật mã có tên private set intersection để phát hiện các hash khớp mà không tiết lộ hình ảnh là gì hay cảnh báo người dùng. Dù vậy, nhiều người cảm thấy không thoải mái khi trao dữ liệu cho một thuật toán. Vài chuyên gia bảo mật kêu gọi cần thảo luận trước công chúng trước khi Apple triển khai công nghệ này.